随着人工智能技术的迅猛发展,关于其潜在威胁的讨论日益激烈,尤其是在人工智能基础软件开发领域。这一争议不仅牵涉技术安全问题,更触及伦理、就业和社会结构等多个层面,成为全球科技界与公众关注的焦点。

一方面,支持人工智能威胁论的观点指出,基础软件作为AI系统的核心,其开发若缺乏有效监管,可能导致不可控的风险。例如,自主决策系统的错误或被恶意利用可能引发重大安全事故;算法偏见可能加剧社会不公;而高度自主的AI甚至可能超越人类控制,威胁人类社会稳定。这些担忧促使许多专家呼吁在基础软件开发阶段嵌入严格的伦理框架和安全机制。

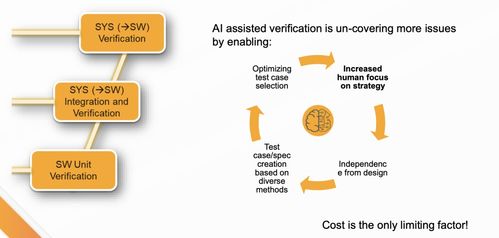

另一方面,反对威胁论的声音强调,人工智能基础软件的开发正通过透明化设计、多方协作和持续测试来降低风险。开源社区和跨国公司的共同努力,已推动了许多安全标准的建立。AI在医疗、教育和环保等领域的积极应用,证明了其潜力远大于威胁。关键在于人类如何引导技术发展,而非技术本身。

在基础软件开发的具体实践中,争议往往集中于数据隐私、算法公平性和系统鲁棒性。开发者需平衡创新与责任,例如通过可解释AI技术增强透明度,以及构建抗攻击的软件架构。政策制定者正逐步出台法规,如欧盟的AI法案,以规范开发流程。

人工智能威胁论的最大争议并非否定技术进步,而是如何确保基础软件开发以人为本。通过跨学科合作、伦理教育和全球治理,我们有望将AI转化为推动社会进步的强大工具,而非不可控的威胁。持续对话与迭代优化将是化解争议的关键路径。