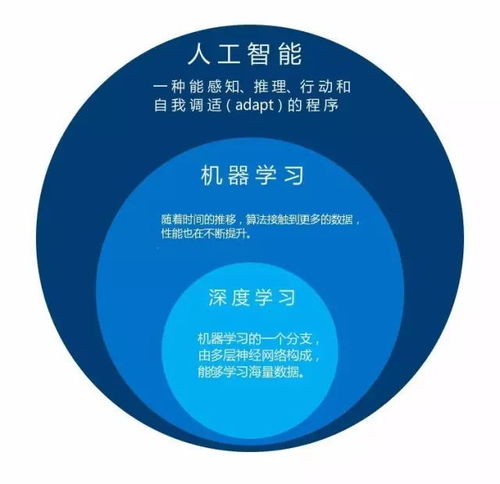

人工智能技术飞速发展,AI智能体作为能够自主感知、决策和执行任务的智能系统,正逐步从实验室走向规模化应用。构建稳定、高效且可扩展的AI智能体基础设施,成为众多企业和开发者面临的核心挑战。容器技术,凭借其轻量、可移植、资源隔离和快速部署等特性,为AI智能体基础设施的落地提供了理想的解决方案。本文旨在探讨基于容器构建AI智能体基础设施的实践路径,为2025年及以后全球人工智能的开发与应用提供参考。

一、 AI智能体对基础设施的核心需求

AI智能体的运行与传统的单体应用或微服务有显著不同,其对基础设施提出了独特要求:

- 环境复杂性与依赖隔离:智能体的开发与运行通常涉及复杂的软件栈,包括特定的深度学习框架(如PyTorch, TensorFlow)、编程语言版本、系统库以及模型文件。容器技术能够将应用及其所有依赖打包成一个独立的、可复现的单元,彻底解决“在我机器上能运行”的环境一致性问题。

- 弹性伸缩与资源利用率:智能体的工作负载可能呈现显著的波峰波谷,例如在模型训练、批量推理或应对突发请求时。基于容器编排平台(如Kubernetes),可以实现智能体实例的自动水平伸缩,根据实时负载动态调整资源分配,极大提升了硬件资源的利用率和成本效益。

- 快速迭代与持续交付:AI模型的迭代速度极快。容器镜像作为交付物,使得从开发、测试到生产环境的流程标准化、自动化。结合CI/CD流水线,可以实现智能体代码和模型的快速、安全、可靠部署。

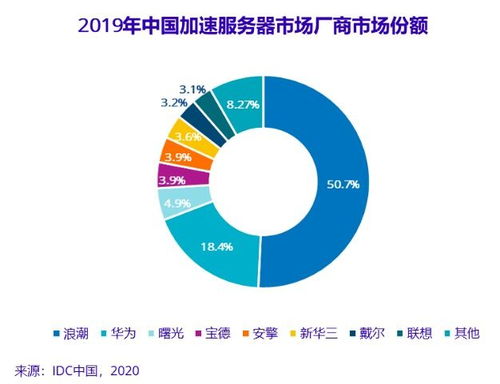

- 异构计算支持:AI计算密集型任务往往需要GPU、NPU等异构硬件加速。现代容器运行时和编排器能够很好地识别和调度这些特殊资源,使得智能体可以透明地利用底层异构算力。

二、 基于容器的AI智能体基础设施架构实践

一个典型的容器化AI智能体基础设施架构通常包含以下层次:

- 基础设施层:提供裸金属、虚拟机或云主机,并配备必要的CPU、内存、存储及GPU等异构计算资源。

- 容器运行时与编排层:以Kubernetes为核心,负责容器的生命周期管理、调度、服务发现、网络和存储编排。这是整个基础设施的“操作系统”。

- AI专项服务层:在K8s之上构建支撑AI工作负载的专项服务,这是关键所在。包括:

- 镜像仓库:存储和管理所有智能体及基础组件的Docker镜像。

- 流水线与实验跟踪:集成MLflow、Kubeflow Pipelines等工具,管理模型训练实验、记录参数与指标、自动化构建推理服务镜像。

- 模型仓库:集中存储和管理训练产出的模型文件,支持版本控制。

- 服务网格与API网关:管理智能体服务间的通信、流量治理、认证授权,并为外部提供统一的API入口。

- 监控与可观测性:集成Prometheus、Grafana、Jaeger等,对容器资源、智能体服务性能、业务指标及分布式链路进行全方位监控。

- 智能体运行时层:运行业务AI智能体的容器实例。每个智能体可以封装为一个或多个协作的微服务(如感知模块、决策引擎、执行器),每个微服务运行在独立的容器中,通过轻量级网络进行通信。

三、 关键落地实践与挑战应对

- 镜像构建优化:AI基础镜像往往很大。实践上应采用分层构建,将稳定的基础环境(如OS、CUDA)与频繁变动的应用代码、模型分离。利用多阶段构建减小最终镜像体积,并善用镜像缓存加速构建过程。

- GPU等异构资源管理:使用Kubernetes的Device Plugin机制(如NVIDIA GPU Operator)来暴露和管理GPU资源。通过设置资源请求(requests)和限制(limits),确保关键智能体任务能获得所需算力,同时避免资源争抢。

- 数据持久化与访问:智能体需要高效访问训练数据、模型文件和持久化状态。需要为容器配置持久卷(Persistent Volume),并针对不同的IO模式(如高吞吐读取训练数据、低延迟读写模型)选择合适的存储后端(如对象存储、分布式文件系统、高性能本地SSD)。

- 服务编排与通信:复杂的智能体可能由多个协同工作的组件构成。使用Kubernetes的Deployment、StatefulSet管理无状态和有状态组件,使用Service和Ingress暴露服务。对于复杂的任务流,可采用Argo Workflows等进行工作流编排。

- 安全与合规:这是企业级落地的生命线。实践包括:使用私有镜像仓库;扫描镜像漏洞;实施网络策略(NetworkPolicy)限制不必要的容器间通信;为服务账户配置最小权限原则(RBAC);对敏感数据(如模型、配置)进行加密管理。

四、 展望:面向2025的AI基础软件开发

随着AI智能体向更复杂、更自主的方向演进,其基础设施也将持续进化:

- Serverless AI:进一步抽象基础设施管理,开发者只需关注智能体逻辑和模型,由平台自动处理资源供给、伸缩至零等,实现更高的运维效率。

- 混合云与边缘协同:容器和K8s提供了统一的抽象层,使得智能体可以无缝运行在数据中心、公有云和边缘设备上,实现云边端一体化的协同推理与学习。

- 智能体专用框架与运行时:可能出现更轻量、启动更快、资源占用更少的“智能体优化容器运行时”,以及专门用于编排智能体生命周期(如学习、记忆、协作)的框架。

- 绿色与可持续计算:通过更精细的容器资源调度和智能伸缩策略,优化AI计算的能效比,降低总体拥有成本(TCO)和环境足迹。

容器技术为AI智能体提供了坚实、灵活且面向未来的基础设施基石。通过系统性的架构设计和对关键挑战的务实应对,企业和开发者能够构建出能够支撑下一代AI应用创新的强大平台,从容应对2025年全球人工智能开发与应用浪潮中的机遇与挑战。